Juristische Definition: Was gilt als KI-System?

Der AI Act definiert KI-Systeme als autonome, adaptive Technologien, die Daten auswerten und eigenständig Entscheidungen ableiten.

Mit dem EU AI Act hat Europa im August 2024 weltweit erstmals einen umfassenden Rechtsrahmen für Künstliche Intelligenz (KI) geschaffen. Ziel ist es, Innovation zu ermöglichen und gleichzeitig Risiken für Gesellschaft, Wirtschaft und Grundrechte zu minimieren. Österreichische Unternehmen stehen nun vor der Aufgabe, sich rechtzeitig vorzubereiten – denn die Pflichten greifen stufenweise und werden bereits 2025 spürbar.

Der AI Act verfolgt drei Kernziele:

Sicherheit und Grundrechte schützen – KI darf Menschenrechte, Privatsphäre oder Sicherheit nicht gefährden.

Transparenz und Verantwortlichkeit sicherstellen – klare Vorgaben zu Nachvollziehbarkeit, Kennzeichnung und menschlicher Aufsicht.

Innovation fördern – ein europaweit einheitlicher Rechtsrahmen verhindert Unsicherheit und schafft Investitionssicherheit.

Damit ist der AI Act für Unternehmen in Österreich vergleichbar mit der DSGVO, nur eben im Bereich der Künstlichen Intelligenz.

Herzstück der Verordnung ist die Einteilung von KI-Systemen nach Risikostufen. Je höher das Risiko, desto strenger die Pflichten:

Unzulässiges Risiko (verbotene Anwendungen): Beispiele sind Social Scoring, biometrische Echtzeitüberwachung oder manipulative KI-Spielzeuge. Diese sind in der EU komplett untersagt.

Hohes Risiko: KI in kritischen Infrastrukturen (z.B. Energie, Verkehr), Gesundheitssystemen, Kreditvergabe oder HR. Hier besteht die Pflicht zu Risikomanagement, Dokumentation, Transparenz, menschlicher Aufsicht und Konformitätsbewertungen.

Begrenztes Risiko: Chatbots, Sprachassistenten bringen Transparenzpflicht, d.h. Nutzer*innen müssen wissen, dass sie mit einer KI interagieren.

Minimales Risiko: Spamfilter, Videospiele, Empfehlungssysteme im E-Commerce – hier bestehen keine besonderen Pflichten.

Dieser risikobasierte Ansatz sorgt für Balance: Strenge Regulierung bei sensiblen Anwendungen, Freiheit bei innovativen Alltagslösungen.

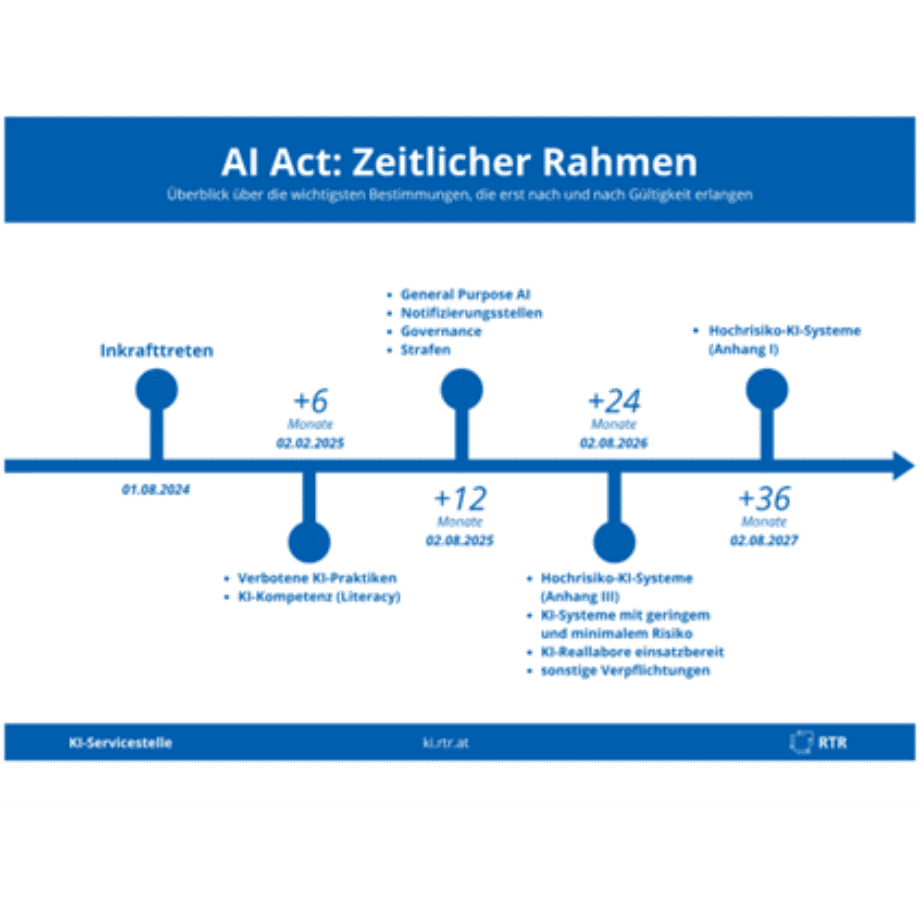

Der AI Act ist seit 1. August 2024 in Kraft. Seine Vorgaben greifen schrittweise:

Seit 2. Februar 2025: Verbotene KI-Praktiken sind untersagt und es gilt eine KI-Kompetenz-Pflicht, d.h. Betreiber*innen und Entwickler*innen müssen sicherstellen, dass ihr Personal geschult ist.

Seit 2. August 2025: Transparenzpflichten für generative KI (GPAI), d.h. KI-generierte Inhalte müssen klar erkennbar sein (z. B. im Marketing, in Medien oder im Bildungsbereich).

Ab 2. August 2026: Konformitätsverfahren, Dokumentation und Audits werden für Hochrisiko-Systeme vollständig verpflichtend. General-Purpose-AI fällt unter die Aufsicht des neuen EU AI Office.

Sanktionen: Verstöße können mit bis zu 35 Mio. Euro oder 7 % des weltweiten Umsatzes geahndet werden, je nach Schweregrad des Verstoß.

Der AI Act sieht gestaffelte Bußgelder vor, je nach Schweregrad des Verstoß.

Bis zu 35 Mio. € oder 7 % Umsatz bei verbotenen Anwendungen.

Bis zu 15 Mio. € oder 3 % Umsatz bei Verstößen gegen Hochrisiko-Pflichten.

Bis zu 7,5 Mio. € oder 1 % Umsatz bei Verstößen gegen Auskunfts- und Dokumentationspflichten.

Für KMU und Start-ups gelten verhältnismäßige Anpassungen, um Innovation nicht zu bremsen.

Österreich hat bereits begonnen, den AI Act organisatorisch einzubetten:

Das Bundeskanzleramt hat einen KI-Umsetzungsplan vorgestellt.

Die Wirtschaftskammer Österreich (WKO) informiert mit Kampagnen über Pflichten und Fristen.

Die RTR hat eine eigene KI-Servicestelle eingerichtet – als zentrale Beratungs- und Informationsplattform für Unternehmen, Behörden und Bürger*innen. Sie koordiniert Fragen zu Compliance, Transparenz, Cybersecurity und Rechtsumsetzung.

Während die Umsetzung der NIS2-Richtlinie in Österreich noch aussteht, ist der AI Act bereits unmittelbar anwendbar – Unternehmen müssen also jetzt handeln.

Viele Unternehmen fragen: „Wie passt der AI Act zur DSGVO und zur NIS2-Richtlinie?“

DSGVO: Regelt den Schutz personenbezogener Daten, ergänzt durch den AI Act, wenn KI-Systeme diese verarbeiten.

NIS2: Stärkt die Cybersecurity für kritische Infrastrukturen, während der AI Act speziell KI-Risiken und Transparenz reguliert

Unternehmen sollten Synergien nutzen und AI-Compliance direkt in bestehende ISMS und Datenschutzprozesse integrieren.

Bestandsaufnahme: Welche KI-Systeme sind im Einsatz?

Risikoklasse bestimmen: Hochrisiko oder begrenztes Risiko? Generative KI?

KI-Kompetenz sichern: Schulungen für Entwickler*innen, Betreiber*innen, Entscheider*innen.

Governance verankern: Integration in ISMS, Compliance- und Datenschutzstrukturen.

Dokumentation & Nachweise: Prozesse frühzeitig aufbauen, um bei Prüfungen vorbereitet zu sein.

Der EU AI Act ist kein fernes Zukunftsthema, er ist jetzt Realität. Für Unternehmen in Österreich gilt: Wer frühzeitig Strukturen schafft, Compliance-Prozesse aufsetzt und Mitarbeitende schult, gewinnt nicht nur Rechtssicherheit, sondern auch einen strategischen Vorteil.

AI-Compliance wird zum Gütesiegel verantwortungsvoller Innovation – und entscheidet künftig über Vertrauen, Marktchancen und Wettbewerbsfähigkeit.